Clarote & AI4Media / AI Mural / Licenced by CC-BY 4.0

Il y a tout juste un an, début 2025, j’écrivais :

En 1930, John Maynard Keynes imaginait que la mécanisation autoriserait « une semaine de quinze heures » tout en consacrant « nos énergies encore disponibles à des buts non économiques » un siècle plus tard, c’est-à-dire en 2030. Dans les années 2020, le travail hebdomadaire moyen se situe toujours autour des 30 à 35 heures entre 25 et 55 ans1. Où est donc l’impact de l’automatisation ? Alors qu’on nous la présente comme une nécessité économique et concurrentielle, ce chômage technologique évoqué par Keynes est largement surestimé, et cache plutôt des orientations économiques importantes en nous privant de questions politiques importantes, telles que la détermination des salaires, la localisation et les conditions du travail, pour quelle production, pour qui, par qui2.

Les concepteurs des IA essaient à tout prix de nous cacher une somme énorme de travail humain, afin de présenter leur « outil » comme une espèce de baguette magique qui nous soulagera de tâches ingrates3, masquant le fait qu’ils n’ont fait que déplacer le travail ailleurs (notamment dans le but de le payer moins cher). C’est mathématique, et ils ne peuvent pas l’ignorer ; mais il est plus facile pour le monde occidental, du bon côté de l’IA, de fermer les yeux et de ne pas s’en préoccuper.

Un an s’est donc écoulé, une année qui a vu progresser une certaine critique de l’I.A., et plus récemment émerger, bien que trop discrètement, le sujet de l’esclavage qui se cache derrière ces soi-disant « intelligences artificielles ». Esclavage. Je n’utilise pas le mot ici par provocation ni avec exagération, mais bien pour décrire la réalité d’un monde néo-colonial numérique.

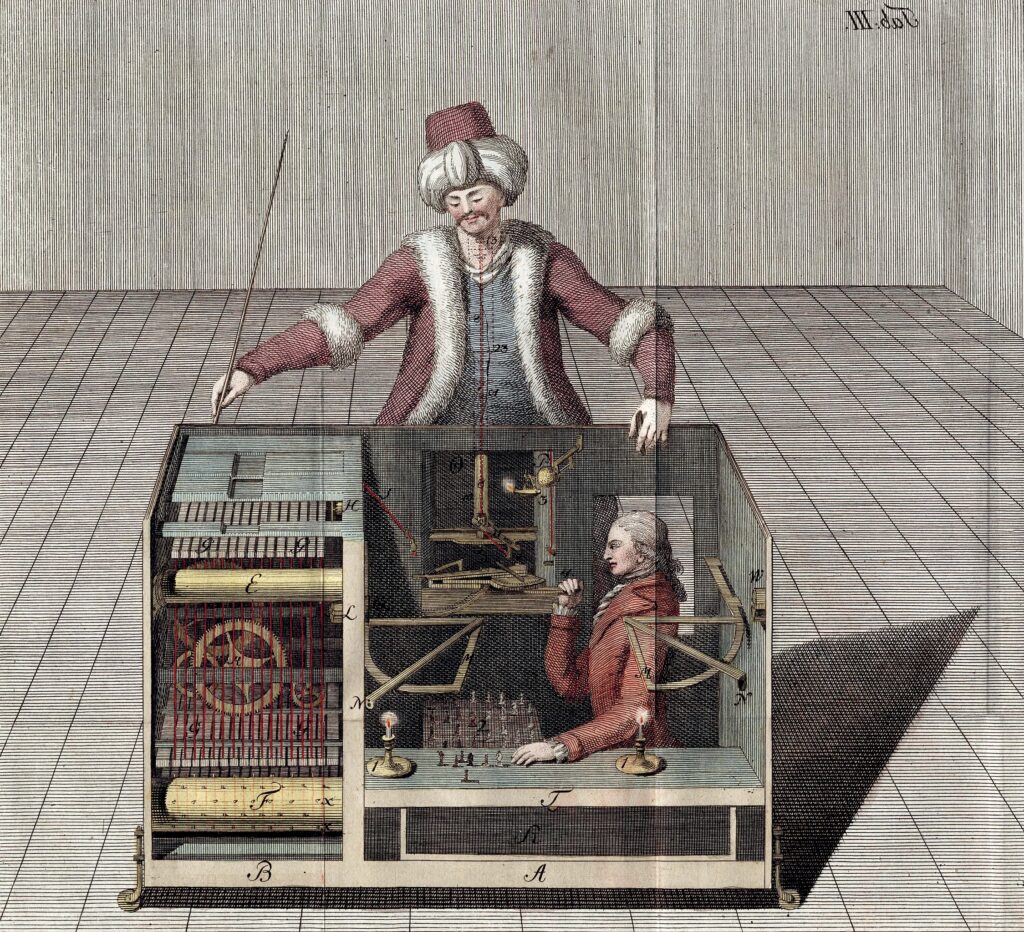

Du turc mécanique à Amazon

En 1769, un siècle après l’idée du calculus ratiocinator de Leibniz mais 220 ans avant l’ordinateur Deep Blue d’IBM, l’ingénieur hongrois Johann Wolfgang von Kempelen fit sensation en présentant en Europe son incroyable automate capable de jouer aux échecs, qu’on surnomme le « Turc mécanique ». Le robot avant l’heure avait en effet une apparence humaine, moustachu et portant un turban, assis derrière un buffet. Il fonctionnait bien et gagnait souvent les parties auxquelles il jouait ; il a vaincu aussi bien Benjamin Franklin que Napoléon 1ᵉʳ.

Mais le turc mécanique était en fait contrôlé par un véritable joueur d’échecs dissimulé dans le buffet. Nous allons voir que malgré son nom, l’intelligence artificielle d’aujourd’hui ne diffère pas vraiment de cet « automate ».

Le turque, Joseph Racknitz, 1789

C’est en 1997 que Deep Blue a battu le champion d’échecs Garry Kasparov. Un ordinateur, une I.A. entrainée avec des milliers parties déjà jouées, notamment de grands maîtres des échecs et dont le développement était supervisé par des joueurs. Là aussi, en ce sens, il est difficile de parler de véritable intelligence artificielle alors que celle-ci ne fait que reproduire ce que des humains ont eu le plus grand mal à lui inculquer, et dont les performances sont indissociables de la qualité et de la quantité des données d’entrainement.

En 2005, Amazon remet le turc mécanique au goût du jour avec « Amazon Mechanical Turk » ou « MTurk ». Là aussi, l’idée est d’utiliser le travail humain avec l’ordinateur comme interface. À l’origine, le but était de profiter de milliers de cerveaux pour les besoins de la plateforme de vente Amazon, en sélectionnant les meilleures photographies des produits, en rédigeant les descriptifs, en classifiant les produits, les musiques… Des opérations impossibles à automatiser, mais que des internautes seraient prêt à effectuer pour de petites sommes, voire juste des bons d’achat. Mais rapidement l’entreprise a compris que l’idée pourrait avoir des applications bien plus vastes et met en place la plateforme MTurk, qui devient une filiale d’Amazon. Le système est entièrement automatisé pour ne pas avoir à s’encombrer de la gestion humaine, et le client peut avoir l’impression d’utiliser un système entièrement automatique, commandant en quelques clics (ou via une interface de programmation) n’importe quelles « micro-tâches » simples en grande quantité, et recevant le résutlat rapidement. N’importe qui peut profiter du service et définir le propre prix de ses tâches, sur lequel Amazon prélève une commission d’une dizaine de pourcents. Le prix le plus courant est de un à deux centimes par tâche, qui peut être de fournir la liste des trois meilleurs albums de Metallica ou donner la meilleure adresse pour manger un hamburger à Paris, ou encore plus simplement, reconnaitre des objets dans une photo. Amazon parle d’ « intelligence artificielle artificielle ». Ce système très rapide et abordable est utilisé aussi bien commercialement que par des études scientifiques nécessitant le traitement d’un grand nombre données.

On peut situer en 2007 le coup d’envoi de l’entrainement des I.A. via le classement des données par des humains, avec la création de ImageNet, un grand ensemble de données visant à entrainer la reconnaissance d’image. L’équipe d’ImageNet a calculé qu’il faudrait 19 ans à des étudiants pour annoter les millions d’images nécessaires. Ils se sont alors tournés vers Amazon Mechanical Turk et 50 000 travailleurs et travailleurs à travers 167 pays en les payant deux centimes de dollar par annotation. La motivation première est bien financière : il serait impossible d’effectuer ce travail au sein des entreprises de la tech. Mais il n’y a pas qu’une raison financière : cette division extrême du travail permet aussi une grande souplesse, les tâches et l’organisation pouvant être ajustées en temps réel, sans préavis, tout en profitant d’une diversité culturelle et linguistique impossible à avoir autrement4. Ces aspects sont tous primordiaux dans le développement des I.A. modernes.

Entraîner la machine

L’apprentissage dit cyniquement « automatique », qui est à la base de toutes intelligences artificielles aujourd’hui, repose en réalité sur un travail, humain et manuel, de classification, de préparation, de vérification et d’annotation des données.

On peut distinguer trois grandes familles d’algorithmes servant à entraîner les intelligences artificielles5, c’est-à-dire à leur injecter les données sur lesquelles elles travaillent tout en s’assurant qu’elles répondront correctement aux problèmes qu’on leur soumettra par la suite.

L’apprentissage dit « supervisé », la famille la plus répandue, nécessite aussi bien une immense quantité qu’une excellente qualité des données, c’est-à-dire très complètes et annotées. L’algorithme d’apprentissage doit pouvoir accéder à des données de test ; par exemple, pour que l’I.A. puisse distinguer des images de chiens d’autres animaux, il lui faut un ensemble de données contenant aussi bien des photos de chiens, labellisées comme telles, « taguées », et des photos sans chien, taguées « autre ». L’I.A. pourra alors associer le mot « chien » à son apparence visuelle. On peut alors facilement imaginer le travail de classification immense à faire, à taguer des millions d’images, pour développer des I.A. généralistes capables de tout reconnaitre ou générer. Plus les tags sont précis dans les ensembles de données, mieux la solution pourra être ajustée et généralisée à de nombreux cas, allant de la classification à la génération de contenu, ou par exemple à la conduite automatique qui a aussi besoin de reconnaitre les éléments croisés sur la route6. C’est la méthode la plus courante, aussi bien pour les I.A. dites génératives que celles qui servent à analyser des images, par exemple pour les diagnostics médicaux.

Une deuxième famille est l’apprentissage automatique « non supervisé ». Ici, les données n’ont pas besoin d’être classées, et l’algorithme se contente de trouver les motifs qui se répètent dans les données. Cette méthode sert surtout quand l’objectif de l’I.A. qu’on entraine n’est pas clairement prédéterminé ou pour des analyses exploratoires. Cette méthode peut servir de base aux grands modèles de langage tels que ChatGPT, tout en restant insuffisante et reste combinée aussi à une forme d’apprentissage supervisé.

La troisième famille est celle de l’apprentissage par renforcement, qui correspond à ce qu’on peut qualifier d’essai-erreur. Dans ce cas, une boucle de rétroaction sert à corriger automatiquement le comportement de la machine qui s’améliore peu à peu. C’est une méthode utile par exemple pour apprendre une voiture à conduire seule, un robot à marcher ou bien entraîner une I.A. dans un jeu vidéo.

Quoiqu’il arrive et avant même l’entraînement des I.A., il est bien connu de tout le monde que la première fondation indispensable à leur fonctionnement est bien l’existence même de toutes ces données d’entraînements, c’est-à-dire l’immense travail humain préalable, la quasi-intégralité de ce que l’humanité a pu produire et qui nous est parvenu et a été digitalisé et ingéré, avec ou sans le consentement des auteurs, légalement ou illégalement.

Seulement ensuite peut se faire l’entrainement de l’immense majorité des I.A., et qui nécessite aussi une importante intervention humaine, pour classer les données d’apprentissage aussi bien que contrôler leur comportement final. Les « captchas » présentant divers exercices aux visiteurs de sites internet pour les différencier des robots incapables d’effectuer ces tâches qui nous semblent si simples, comme reconnaitre une moto dans une photo ou emboiter deux pièces de puzzle, sont un bon exemple de ces micro-tâches qui permettent de préparer les données d’apprentissage. S’ils servent effectivement à l’entrainement des I.A., ils sont loins, très loins de suffire face aux besoins gargantuesques des I.A., et de remplacer les plateformes comme Amazon Mechanical Turk.

Les tâches à effectuer dans ce cadre sont effectivement très majoritairement stupides et ingrates, en voici quelques exemples pour bien comprendre que la somme de tâches à accomplir est virtuellement infinie, les I.A. ne sachant rien apprendre ni comprendre par elles-mêmes.

- Dans le cas des assistants vocaux, il faut que la machine s’exprime avec et comprenne le bon accent dans la bonne langue. Il faut alors enregistrer de nombreuses commandes vocales pour l’entrainer, avec des locuteurs natifs de toutes les langues et avec tous les accents de ses potentiels utilisateurs. On va par exemple demander à des gens d’enregistrer cinq manières différentes de demander la météo à un assistant, dans leur langue natale ; et il faut qu’un très grand nombre de gens se prêtent à l’exercice, sur de nombreuses commandes différentes.

- Pour entraîner des machines travaillant avec l’image, il faut non seulement annoter des millions d’images pour en décrire le contenu, mais il faut aussi y entourer précisément les éléments à reconnaitre. Un simple cadre ne suffisant pas, il faut détourer avec précision tout ce qu’il y a à reconnaitre et annoter : que ce soient des animaux, des objets, des bâtiments, ou des cadavres, des blessures, des maladies… C’est ce qu’on appelle la segmentation sémantique. Ce travail, impossible avec des logiciels standards, fait l’objet de développement avancé pour aider à augmenter la précision des travailleurs, usant lui-même d’apprentissage automatique7, dans une course sans fin aux détails et à l’efficacité obligeant à constamment entrainer à nouveau la machine.

On peut par exemple demander à des gens de différencier des palmiers et des piétons, pour aider les voitures autonomes8, ou encore de taguer des images pour aider les I.A. à générer des images de célébrités9. - Pour entrainer diverses machines de contrôle, par exemple des caméras de surveillance ou de modération, il faut annoter les événements à détecter ; cela va des vols à la violence, la pornographie, le terrorisme… Il y a d’ailleurs eu une augmentation notable de ce genre de tâches après la période 2015-2016 avec l’augmentation de la demande en modération et systèmes de surveillance. Ce genre de tâche ne pourra d’ailleurs jamais être complètement automatisé, alors que tout nouveau type de données demande de nouveaux entraînements de la machine.

Mais il ne faut pas seulement entrainer les I.A., il faut aussi les « aligner », c’est-à-dire corriger ce qu’elles font mal une fois qu’elles ont été entraînées, en corriger les biais, contrôler la conformité de ce qu’elles font – c’est d’ailleurs ce contrôle qui va faire toute la différence entre un ChatGPT de OpenAI et un Grok de xAI et Elon Musk : les deux sont alignés très différemment ; et contrairement à ce qu’on peut entendre dans la désinformation typique des plus fascistes des développeurs des I.A. comme Elon Musk, ce qui différencie Grok, son modèle de langage, n’est pas d’être moins contrôlé et plus « libre » de sa parole, mais bien d’être aligné différemment. On le constate facilement en analysant les biais récurrents de sa parodie d’encyclopédie Grokipedia, générée grâce à Grok, et qui s’éloigne des consensus scientifiques et culturels bien établis, prouvant bien l’orientation maîtrisée, manipulée, donnée à Grok. Voici d’autres exemples.

- Pour peaufiner le fonctionnement des outils de transcription écrite de dialogues, il faut par exemple comparer la transcription faite par l’humain de celle faite par la machine pour en corriger les erreurs de grammaire ou de syntaxe, ou encore annoter les éléments de la bande audio qui auraient pu induire la machine en erreur, comme les bruits parasites, les accents, les mots mal prononcés…

- On aligne et on évalue les modèles de langage en comparant l’adéquation entre leurs réponses et les demandes des utilisateurs : il faut alors noter la pertinence et la crédibilité des versions pour en améliorer les performances ou corriger les inévitables biais et erreurs les plus grossières. Des chercheurs ont ainsi pu récolter des témoignages10 de personnes chargées de contrôler le fonctionnement d’I.A. de cette manière bien après qu’elles aient été entraînées, testées et mises sur le marché, dans un effort continu de s’assurer qu’elles fonctionnent correctement et ne dévient pas.

On pourrait ajouter aussi un troisième encadrement humain des I.A., « l’humain dans la boucle », ce qu’une étude appelle la personnification de l’I.A.11, ou plus prosaïquement, la triche. Il n’est en effet pas si rare que derrière des systèmes dit « artificiels » se cachent en réalité des humains qui contrôlent et ajustent le système en temps réel. C’est notamment le cas des voitures autonomes, les robots-taxi, comme j’ai déjà pu l’écrire précédemment, et qui est confirmé pour ceux d’Alphabet, la maison mère de Google, de l’entreprise Waymo12, qui roulent aux États-Unis en pouvant être contrôlés depuis… Les Philippines ! Des témoignages font aussi état de « caméras intelligentes » en réalité surveillées depuis l’autre bout du monde par des opérateurs tout à fait humains. L’idée du turc mécanique fait long feu.

Ce sont là des micro-tâches simples, mais qui ont besoin d’être répétées un nombre immense de fois ; ce ne sont pas des types de tâches nouvelles dans le monde numérique ni même propres à l’I.A., bien que l’I.A. ne puisse absolument pas exister sans cet énorme travail humain. Ces micro-tâches s’inscrivent en fait, et profitent, d’un système plus ancien que la mode de l’I.A. et déjà bien rodé. On peut en lister quatre grandes catégories : l’entrainement des I.A. comme on vient de le décrire, mais aussi la modération de contenu (dans laquelle s’insère l’alignement des I.A.), les tests d’usage à distance des outils, et la manipulation des médias et réseaux sociaux.

Le DiPLab de l’institut polytechnique de Paris liste ces micro-tâches dans un classement en trois types13 :

- Sur les données :

annotation de texte et image, transcription audio et vidéo, évaluation des publicités, classement de contenu pour l’entrainement des I.A… - Tâches de test et d’évaluation :

tests d’applications et de site web, critique de produits, tests de jeux, sondage d’études de marché… - Tâches promotionnelles :

regarder des vidéos (pour augmenter le nombre de vues), souscription à des chaînes, « liker », commenter des posts, générer de l’engagement sur les plateformes telles que YouTube, Facebook, Spotify, Instagram, Tiktok…

Le monde numérique et en particulier les I.A., toutes les I.A., reposent donc sur un travail humain bien réel et indispensable14, dans une quantité qui contrebalance largement les soi-disant économies et gains de temps que représentent ces outils pour leurs usagers, qui ne font que profiter du travail d’autres gens qu’ils ne connaissent pas. Mais qui sont donc ces travailleurs de l’ombre, et qui les font travailler, dans quelles conditions ?

Le business des micro-tâches numériques

Bien évidemment, dans un monde capitaliste mondialisé, les éditeurs et développeurs d’I.A. ne prennent pas eux-mêmes directement en charge la gestion de toutes ces micro-tâches ; ils peuvent acheter des ensembles de données déjà classées (ou profiter de ceux accessibles librement), mais ils font surtout très majoritairement appel à des prestataires et des plateformes de microtravail.

On estime ce marché mondial à plusieurs milliards, voire plusieurs dizaines de milliards de dollars15 16.

Quelques grandes entreprises se partagent le marché, au-delà de l’historique Amazon Mechanical Turk, plus ou moins spécialisées dans l’I.A. : ScaleAI (qui vaut plus d’une dizaine de milliards de dollars et en pleine croissance), SurgeAI, Appen, Sama, Lionbridge AI, Microworkers, UHRS, Clickworker, Toloka, Fiverrr, Upwork ; mais aussi d’inombrables autres plateformes, dont certaines sont des filiales des autres ou des plus grandes de ces entreprises, telles que Remotasks (qui appartient à ScaleAI), Contra, Telus, Oneforma, Spoutgigs, Outlier AI, Mostaql, uTest, UNU, Timebucks, Pawns, CortalyCash, ySense, Honey Gain, Populii…

Certaines de ces entreprises sont présentes dans divers pays, mais la plupart sont surtout des plateformes en ligne permettant à n’importe qui, n’importe où dans le monde, de s’inscrire pour effectuer des micro-tâches ; ces travailleurs et travailleuses généralement « indépendantes » sont alors payées quelques centimes à la tâche, elles et ils sont des tâcherons exploités au bénéfice des entreprises du numérique et de la tech des pays riches. Évidemment, le droit du travail n’est pas nécessairement respecté, ni les lois des pays dans lesquels vivent ces travailleurs et travailleuses. ScaleAI par exemple respecte peu le droit du travail17 et enchaîne d’ailleurs les plaintes et les procès, et les travailleurs interrogés font par exemple état de paies en retard, voire annulées18 ; un phénomène tout a fait connu en interne comme le montrent des notes révélées par le Washington Post. Des témoignages font état de comptes soudainement supprimés avant d’être payés, ou de plusieurs années d’attente… Cette entreprise travaille directement pour Meta, Microsoft, OpenAI et… le Ministère de la Défense étasunien (renommé Ministère de la Guerre par Donald Trump). Sama de son côté fait face aussi à de nombreuses accusations à propos des souffrances de ses travailleurs et travailleuses chargées de la modération de facebook, dont certains souffrent de stress post-traumatique19…

C’est le point d’orgue de la mondialisation du travail, la délocalisation ultime : à travers ces plateformes, on se fiche de savoir par qui et où le travail est fait, tant qu’il ne coûte presque rien.

Machine intelligence, powered by humans

Slogan de Lionbridge AI

Qui sont les tâcherons ?

Selon un rapport de la Banque Mondiale, ils seraient entre 150 et 400 millions dans le monde entier20, c’est-à-dire entre 4,4 et 12,5 % de la main d’œuvre mondiale. La majorité sont dans des pays du Sud global, notamment aux Philippines, en Afrique (Kenya, Ouganda, Madagascar, Égypte…) et en Inde, mais une partie sont aussi dans les pays plus riches, y compris aux États-Unis où Amazon Mechanical Turk a la majorité de ses travailleurs par exemple. L’image de la tech numérique issue de la Silicon Valley Californienne en prend un coup.

Quoiqu’il en soit, ils sont majoritairement des travailleurs pauvres, des hommes aux trois quarts, entre 18 et 34 ans21 22. Ils sont souvent diplômés, avec un niveau d’étude de Bachelor, le premier cycle universitaire allant jusque Bac+3 en France par exemple, en général scientifique ou technique, et vivent plutôt en ville, où ils peuvent plus facilement avoir un accès internet23. Le point commun de l’immense majorité est qu’ils font ce travail par nécessité financière, et la plupart d’entre eux en ont besoin pour payer leurs factures, alors même que ce salaire indispensable à leur survie est extrêmement faible, variant entre 1 et 4 dollars de l’heure, généralement bien en dessous du salaire minimum des pays où ils vivent24. Des témoignages font état de 1,22 dollar de l’heure en Égypte par exemple25. Les tarifs des tâches ont d’ailleurs tendance à plonger à mesure que les entreprises s’étendent dans de nouveaux pays, mettant ces travailleurs pauvres en concurrence les uns avec les autres. Ces micro-tâches représentent d’ailleurs pour une grande partie des travailleurs un deuxième, voire un troisième travail leur permettant de compléter leurs revenus. C’est très notablement le cas pour les travailleurs de Amazon Mechanical Turk aux États-Unis.

Ils n’ont généralement aucune couverture sociale ni même ne déclarent ces revenus issues généralement d’une forme de travail informelle.

Construire la machine

Ce constat d’impérialisme étant posé, nous sommes, malheureusement, loin d’avoir fini de détricoter cette machine qui n’a déjà plus rien ni d’intelligente ni d’automatique. L’apprentissage, purement numérique de ces neurones purement virtuels, repose pourtant bien sur du matériel bien physique et des matières premières qui ont toutes dû être extraites puis transformées par du travail bien humain. Là aussi, le colonialisme est encore bien présent, et la quantité de travail que ce secteur représente est tout sauf négligeable ; la mode des I.A. de ces années 2020 qui pousse à la construction d’innombrables centres de données et fait exploser les prix des composants indispensables à leur fonctionnement ne fait que pousser à un accroissement de l’exploitation des ouvriers. Il faut ajouter à cela que l’I.A. est une branche de l’informatique qui nécessite des composants électroniques spécifiques, à la fois capables d’une grande vitesse de traitement, mais aussi, par conséquence de leur puissance démesurée, les plus résistants possibles, notamment aux fortes chaleurs qu’ils génèrent. Les métaux et matières premières nécessaires sont alors très spécifiques, et souvent rares.

Prenons un exemple emblématique : les condensateurs utilisent alors du tantale, un métal particulièrement résistant à la corrosion et très bon conducteur aussi bien d’électricité que de chaleur, ce qui en fait une matière première importante dans le domaine. C’est une ressource non renouvelable dont on a produit 2500 tonnes environ en 2025. Sur ces 2500 tonnes, environ un quart vient des mines industrielles, un peu plus de la moitié, de mines artisanales, et le reste du recyclage26. Sur la production minière, plus de la moitié provient de la République Démocratique du Congo, et en particulier de zones militarisées. Et un cinquième de la production mondiale vient d’une mine en particulier, la mine de Rubaya, au Kivu congolais, une zone de guerre où les mines sont sous contrôle militaire, du mouvement M23 et de l’armée rwandaise qui ont annexé en 2024 un quart du Kivu, où sont produits trois métaux indispensables au numérique : l’étain, le tantale et le tungstène. Les attaques contre les civils sont systématiques et les violences sexuelles s’y multiplient « de façon alarmante » selon l’ONU27. Le 28 janvier 2026, 200 mineurs, hommes, femmes et enfants, sont morts ensevelis dans l’effondrement de la mine de Rubaya28. Ces mines « artisanales » à ciel ouvert consistent en fait en de vastes zones parsemées de trous creusés et minés à la main par des centaines, des milliers de gens, sans aucune sécurité, parfois à flanc de montagne.

Malgré tout, la Commission européenne a signé un accord, en février 2024 (tout juste trois mois avant la prise de la mine de Rubaya), qui « établit une coopération étroite entre l’UE et le Rwanda » pour « l’intégration de chaînes de valeur durables pour les matières premières », fondé sur le fait que « le pays est un acteur majeur au niveau mondial dans le secteur de l’extraction de tantale »29. Sauf que ce tantale est en réalité très majoritairement pillé au Congo et non extrait au Rwanda. C’est un fait établi et rappelé par l’ONU depuis 2001, à l’origine même de l’expression « minerais de conflit », que l’Union Européenne a sciemment ignoré avec cet accord, qui encourage et renforce l’offensive très lucrative menée par le Rwanda. Cette exploitation minière en zone de guerre profite de l’investissement d’entreprises européennes telles que la britannique Power Resources et des groupes d’intelligence artificielle comme le polonais Luma Holdings30.

Un problème structurel

Par leur conception, les I.A. statistiques, qui reposent dans leur immense majorité sur un entraînement nécessitant des millions ou des milliards de données, annotées, classées, filtrées par des travailleurs humains, puis sur un alignement là aussi nécessairement humain, mais aussi sur du matériel et des matières premières exploitant des ouvriers et mineurs dans le monde entier, sont structurellement dépendantes de ces chaînes de sous-traitance qui commence dans les start-ups de l’I.A. et se termine sur les tâcherons philippins, indiens, kényans ou les mineurs et mineuses congolaises, par exemple. C’est absolument inévitable, et il faut arrêter d’imaginer les start-ups comme des lieux de conception numérique détachés de ce colonialisme, qui seraient juste des enclos à développeurs informatiques branchés sur internet concevant des I.A. simplement à travers de complexes lignes de code. Toutes les start-ups dépendent des données, des métaux et des semi-conducteurs, dans une quantité qui ne permet et ne permettra jamais leur production éthique, alors même que nous n’avons pas abordé ici les conséquences sur l’environnement planétaire de cette production.

On peut alors mettre un mot plus exact pour qualifier ces tâcherons, ces ouvriers, ces mineurs : ils sont des esclaves, modernes certes, mais pas bien différents depuis toujours, issus de pays pauvres, « d’anciennes » colonies, toujours victimes de l’exploitation par ceux qui possèdent les richesses et la puissance.

- Lire à ce sujet cet article de Martin Anota : Où est la semaine de travail de 15 heures promise par Keynes ? ↩︎

- Lire aussi Derrière les mots « intelligence artificielle » ↩︎

- Parce que oui, dans l’esprit capitaliste et transhumaniste de ces entreprises, même faire de l’art est un travail, une tâche ingrate, dont il faut se libérer. Surtout quand un employeur ou commanditaire doit payer pour. ↩︎

- Logan Kugler, The Invisible Labor Force Powering AI, Communications of the ACM, 2026. ↩︎

- Paola Tubaro, et al., The trainer, the verifier, the imitator: Three ways in which human platform workers support artificial intelligence, Big Data & Society, 2020. ↩︎

- Anja Bechmann, et al., Unsupervised by any other name: Hidden layers of knowledge production in artificial intelligence on social media, Big Data & Society, 2019. ↩︎

- Tubaro, 2020. ↩︎

- Behind the AI boom, the armies of overseas workers in ‘digital sweatshops’, Independant, 2023. ↩︎

- Ibid. ↩︎

- Tubaro, 2020. ↩︎

- Tubaro, 2020. ↩︎

- Waymo got grilled on Capitol Hill as lawmakers accused it of relying too much on Chinese cars and overseas labor, Business Insider, 2026. ↩︎

- Myriam Raymond, et al., Data Work in Egypt. Who are the Workers Behind Artificial Intelligence, DiPLab Report, 2025. ↩︎

- « Human-provided data is absolutely essential. There’s no getting around it. These models couldn’t exist without it. », Antonio Casilli, Waiting for Robots: The Hired Hands of Automation, University of Chicago Press, 2025. ↩︎

- Tubaro, 2020. ↩︎

- Grand View Research ↩︎

- Independant, 2023. ↩︎

- Independant, 2023. ↩︎

- Inside Facebook’s African Sweatshop, Time, 2022. ↩︎

- Namita Datta, Rong Chen, et al., Travailler sans frontières : Promesses et périls du travail à la demande en ligne, La Banque mondiale, 2023. ↩︎

- Myriam Raymond, 2025. ↩︎

- Chiffres de l’Organisation Internationale du Travail. ↩︎

- Casilli, 2019. ↩︎

- Independant, 2023. ↩︎

- Myriam Raymond, 2025. ↩︎

- Article Tantale, L’élementarium, co-édité par France Chimie et la Société Chimique de France (SCF), 2025. ↩︎

- Rapport à mi-parcours du Groupe d’experts sur la République démocratique du Congo, lettre du conseil de sécurité de l’ONU, mise à disposition par Reporterre, 2025. ↩︎

- Celia Izoard, Notre appétit pour l’IA alimente la violence au Congo, Reporterre, 2026 ↩︎

- EU and Rwanda sign a Memorandum of Understanding on Sustainable Raw Materials Value Chains, Commission Européenne, 2024 ↩︎

- Celia Izoard, Un néo-colonialisme technologique : comment l’Europe encourage la prédation minière au Congo, Terrrestres, 2025 ↩︎

Laisser un commentaire