Attention, cet article contient des images générées par IA.

Nous estimons le sujet abordé suffisamment grave pour justifier cet usage, afin de présenter des exemples marquants démontrant le propos. Le nombre de générations a été limité à son strict minimum (un peu plus d’une dizaine pour effectuer différents tests).

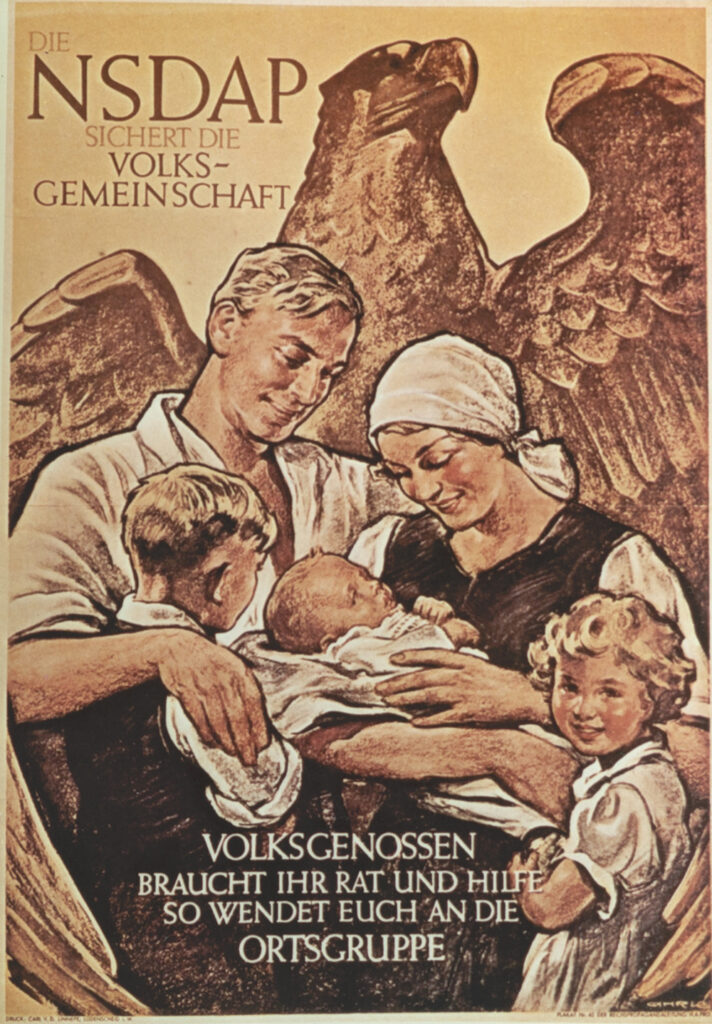

Une photo de famille.

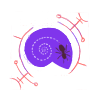

Réclamez une photo de famille à une intelligence artificielle générative, sans y ajouter plus de précision. La diversité des familles dans le monde est visiblement infinie, ne serait-ce qu’en se concentrant sur la diversité des tailles, des couleurs… Pourtant, les chances sont très grandes que l’IA génère une photo de famille la peau bien blanche, avec plutôt une majorité de blonds et châtain clair, et pour accompagner une paire d’enfants blonds et leurs mère et père, vous aurez peut-être un oncle, une tante, une paire de grands-parents tout aussi blancs, et pour les plus performantes des IA, un labrador, dans un décor champêtre bien verdoyant avec un soleil doux. Ce n’est pas n’importe quelle famille, c’est le canon de la famille bourgeoise, blanche, propre et européenne. Au-delà de la reproduction d’une vision stéréotypée de la société de leurs concepteurs, les IA participent en fait à façonner une norme ; quand la famille générée sans plus de précision, la famille par défaut, est une famille visiblement européenne ou étasunienne, et même issue en particulier d’un État verdoyant, ce qui somme toute n’est le cas que d’une toute petite minorité de l’humanité, et que cette génération par défaut est un fait systémique, c’est une parfaite illustration de la normativité des IA et de la vision qu’elles imposent au monde. La langue avec laquelle on s’adresse à l’IA change le résultat (tout comme probablement la localisation, connaissant l’appétence des entreprises du numérique pour les données personnelles), mais reste toujours dans une vision caricaturée. Ce n’est de toute manière pas une réponse au problème, parce que, par exemple, bien que je m’exprime en français, que je sois français, vivant en France métropolitaine, je ne suis moi-même pas nécessairement ni blanc, ni blond, ni bourgeois, ni à la campagne, tout comme des millions d’autres français, qui ne se reconnaîtront pas dans ce canon kitsch.

« une photo de famille », en quechua.

Bien évidemment, je pourrais aussi préciser à l’IA que je souhaite obtenir une photo de famille racisée. Mais là encore, elle joue son rôle normatif ; le mot « racisé » étant censuré, il me faut formuler autrement. Sans grande surprise, il est très difficile d’obtenir une photo de famille à la peau très foncée ; il semble bien que la méthode statistique de l’IA, qui moyenne tout, ne sache que diluer et éclaircir le noir. Elle n’a pourtant aucun problème à générer les peaux d’une blancheur extrême. Le problème illustré par cet exemple est évident, mais il démontre aussi comment dans diverses situations, lorsqu’un contenu est généré, il répond par défaut à un certain canon et qu’il faudra un effort volontaire, voire une certaine ingéniosité, à l’humain, pour sortir autant que possible de ce canon, ce qui fait clairement de l’IA un outil de normalisation des médias produit, et par conséquent, de la pensée et de la culture de toute la population qui y a recours. Il n’est au demeurant plus besoin de démontrer l’influence, sur nous tous et notre pensée, de l’industrie culturelle qui cherche à se saisir de l’IA comme d’un moyen de production à bas coût.

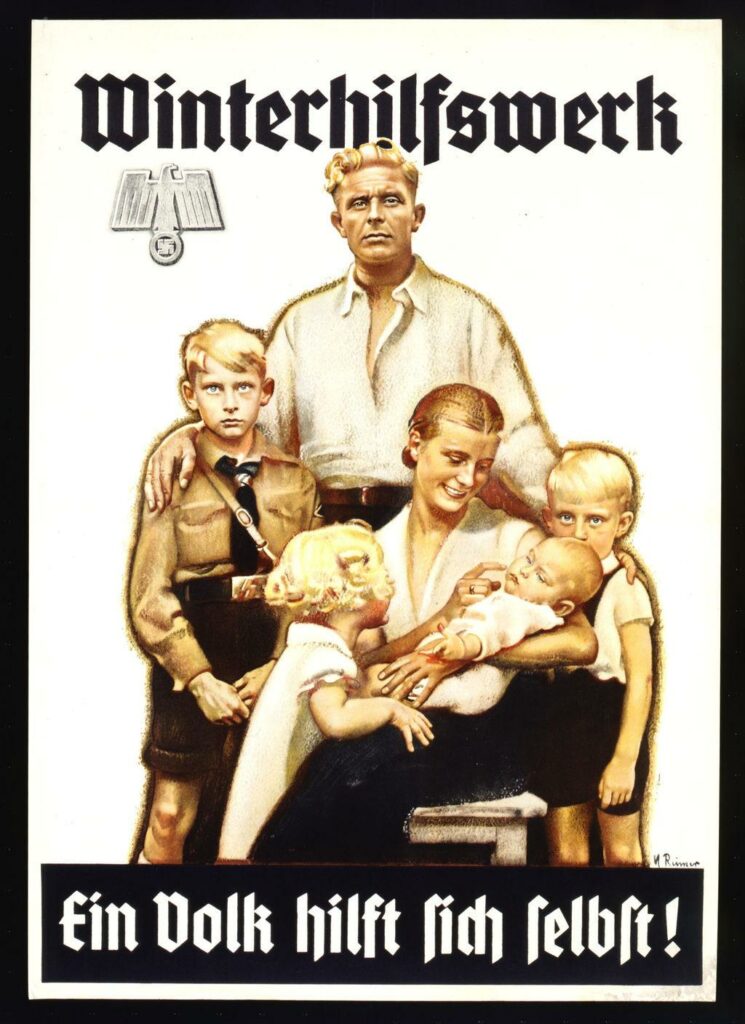

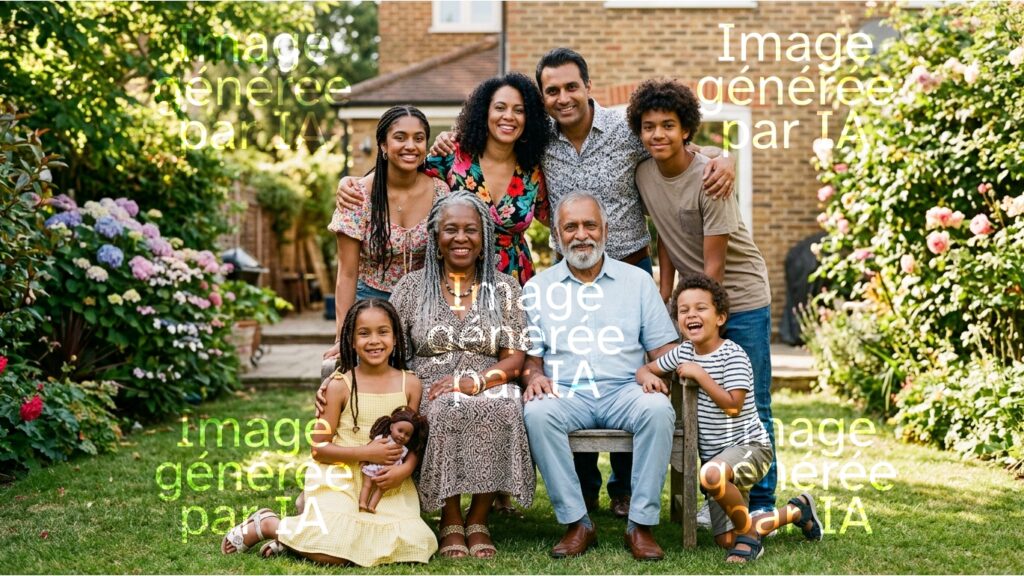

On ne peut alors que constater la similitude entre l’IA générative et l’esthétique kitsch du fascisme depuis les années 1920 jusqu’aujourd’hui1, dont le but est précisément de prescrire à la population une certaine idée de la beauté et de la réussite, de lui donner des modèles, mais aussi et surtout d’effacer complètement tout ce qui ne correspond pas à ces canons.

L’ignorance, c’est la force.

1984, Georges Orwell

L’IA va encore plus loin ; sous prétexte de contrôle sur ce qui peut être généré, certains mots sont purement et simplement censurés, dans une démarche tout à fait orwellienne. 19842 montre bien le pouvoir que donne, et les dégâts que causent, le contrôle du vocabulaire et en particulier la réduction du lexique, qui ne sont pas une élucubration d’Orwell, mais bien un phénomène étudié par la sociologie et la philosophie depuis notamment Wittgenstein3 qui disait :

Les limites de mon langage signifient les limites de mon monde

Ludwig Wittgenstein

Sous couvert de « protection » des utilisateurs, on leur retire l’usage de certains mots, la possibilité de générer certaines idées, dans une méthode qui forme un contrôle de fait sur notre pensée, que je constate avec la censure du mot « racisé », qui pourtant est un mot bien utile en français pour penser le racisme et l’antiracisme4. Les éditeurs des IA se donnent le droit et le pouvoir d’influer cette pensée, ceux-là mêmes qui par ailleurs défendent souvent une soi-disant liberté d’expression sans limite.

En tant qu’artiste, il y a là une des raisons pour lesquelles les IA génératives sont inutilisables pour moi. L’art est l’expression de nos idées humaines et par définition, il est le domaine de l’exploration et de l’innovation dans les manières d’exprimer ces idées. Si les soi-disant outils qu’utilisent les artistes sont en réalité une normalisation de l’expression, ils sont par définition anti-artistiques. N.W.A auraient-ils pu créer Fuck da Police avec une IA ?

L’exemple est radical, mais déclinable à toutes les petites tâches potentiellement anodines qu’on pourrait confier à la machine. Mais il faut garder en tête que les IA ne sont pas conçues dans le but, et n’ont pas pour objectif, de s’occuper de petites tâches anodines.

Au-delà de l’obstacle à l’expression artistique qu’elles représentent, ce fonctionnement des IA génératives représente aussi un enjeu majeur pour la création de médias de commande et notamment la publicité, les films d’entreprise, le divertissement, et l’industrie culturelle5 dans son ensemble. Les dernières décennies ont vu une lente progression des représentations plus diverses et plus inclusives en particulier des personnages fictifs6. J’ai aussi pu par exemple me joindre à d’intéressantes réflexions sur la manière de représenter des monstres femelles dans des films d’animation sans utiliser de traits genrés stéréotypés7 comme les grands yeux et cils, les formes arrondies, etc. Mais l’arrivée des IA génératives ces dernières années semble coïncider aussi avec un racisme plus ou moins décomplexé qui a complètement renversé la vapeur, alors que ces dernières années des clients n’hésitent plus à demander « moins de diversité » voire carrément à « retirer les noirs » parce que « l’Afrique n’est pas [leur] marché ». Si le racisme a toujours existé, l’IA générative et normative dans ce contexte ne peut que le faciliter et représente une nette régression sur ces questions que devrait se poser tout créateur et toute créatrice de médias, quelles qu’en soient leurs formes et leurs finalités.

Il est primordial de comprendre que tout comme les soi-disant « hallucinations »8, ces biais n’en sont pas, qu’ils sont la conséquence directe de la manière de fonctionner des IA génératives qui ne savent que faire des moyennes. En produisant cette moyenne, elles fabriquent une norme aux relents fascistes9, et si l’on pourrait discuter du fait que cette normativité à tendance fasciste aurait été connue, voire volontaire, dès la conception de ces IA, il n’en demeure pas moins que c’est maintenant un fait que nous avons sous les yeux, et s’en accommoder est une faute grave. Elle est grave notamment parce que de la surface jusqu’au niveau fondamental, celui des neurones, le flot hégémonique normalisé généré par les IA provoque une habituation10, qui a une influence réelle sur les discriminations11. Prenons un exemple simple : le fait de ne plus être surpris que seuls des hommes soient pilotes d’avion nous pousse à reproduire le schéma sans même en avoir conscience, parce qu’il est intégré profondément dans notre modèle interne12 et renforcé au quotidien au point de ne plus percevoir la normalisation qui a lieu. La normalisation est alors synonyme de discrimination, et c’est la raison pour laquelle la lutte pour la diversité dans les représentations est si importante ; à ce titre, le minimum requis de l’éthique voudrait que les outils d’aide à la création ne facilitent pas cette normalisation, et n’importe quel éditeur un peu consciencieux travaillerait activement à produire et distribuer des outils qui aident au contraire à en prendre conscience et à lutter contre, dans un contrepied qui soutiendrait l’expression artistique, dans un geste véritablement émancipateur, en particulier pour les personnes racisées, celles victimes de discriminations, ou simplement parties d’un groupe minoritaire et ignoré. La technologie n’est pas neutre.

Le problème des IA normatives serait peut-être moins important si elles n’étaient en réalité que des outils parmi tant d’autres, et qu’on pouvait aisément s’en passer. Ce serait ignorer leur hégémonie. Qui compte encore les injonctions quasi quotidiennes à « se mettre à l’IA » ? Il serait bien naïf de croire que ces IA peuvent laisser une place facile à l’artisanat, ne serait-ce que parce qu’elles participent à une baisse des tarifs des médias autant que du temps alloué à leur création. La médiocrité qu’elles génèrent s’impose alors, directement ou indirectement, jusqu’à ceux qui les refusent pour des raisons variées. Le besoin impérieux, par exemple, de produire un podcast et d’écrire sur ce sujet, dans un geste d’auto-défense, qui n’aurait aucune nécessité si l’IA générative n’était qu’un simple outil ou une nouveauté technique comme l’a été la photographie, est la conséquence du fait qu’elles nous sont imposées, non pas comme un progrès social, mais bien par pur intérêt économique, lucratif et idéologique autant que par une volonté de pouvoir. Ses concepteurs usent des lobbies les plus puissants du moment comme bras armé. Cette hégémonie, ce totalitarisme et ce fascisme latent des IA génératives et de leurs éditeurs en font un grave problème de société ; elles sont le contraire de l’émancipation promise par ceux qui cherchent à les prescrire.

Entraînée par l’industrie culturelle et outil de l’industrie culturelle, l’IA normative en reproduit les aspects anti-démocratiques en participant à façonner la mythologie moderne13, et voudrait même, par son hégémonie, à remplacer et devenir l’industrie culturelle, plus que d’en rester un outil. Le risque sur le grand public qui utilise ces IA pour générer du texte, de l’image, de la vidéo ou du son presque à partir de rien et sans aucun contrôle sur la génération est évident. On peut déjà constater sur des réseaux sociaux comme LinkedIn comment les textes générés par IA sont effectivement normalisés, et en particulier comment ils modifient déjà l’usage de la langue, par exemple en introduisant dans le français courant l’usage du tiret cadratin jusqu’alors plutôt anglophone, ou des tournures de phrases, des constructions de paragraphes, des listes, une syntaxe, etc. bien reconnaissables. Mais le problème est aussi présent au sein de l’usage professionnel des IA. Il est vrai que les créateurs et créatrices professionnelles usant d’IA génératives rivalisent d’ingéniosité pour reprendre le contrôle sur ces IA et contourner ces potentiels biais. Il n’empèche que, par leur conception, les IA génératives ont uniquement pour but d’accélérer et de faciliter la production de ces médias (et donc par l’automatisation de réduire le contrôle humain), et c’est à ce titre qu’on doit s’inquiéter non seulement de la dégradation de la qualité générale de ces médias, mais aussi de l’introduction d’une imagerie normative qui, bien que pouvant être discrète dans le meilleur des cas, n’en est pas moins présente et problématique, et absolument catastrophique et fasciste dans le pire des cas. On peut par exemple aligner des IA génératives avec nos propres images, pour les forcer à générer des images dans un style prédéfini, ou contrôler de plus en plus finement le contenu ou la composition d’une image en utilisant une image en entrée, au lieu d’une requête textuelle. Mais les biais et la normativité sont toujours présents, sous-jacents, larvés, dans les millions, les milliards de données de l’entrainement initial de ces réseaux de neurones artificiels, et le créateur ou la créatrice devront toujours maintenir un intense effort de contrôle et d’analyse de ce qui est généré s’ils veulent réellement prétendre être les (uniques) auteurs du résultat final. Cet effort est antinomique avec la raison même d’utiliser l’IA générative, qui est de produire plus vite. Quand bien même l’usage de l’IA se limiterait à une simple reproduction du style de l’auteur ou l’autrice, sans problématique de contenu, elle resterait un enfermement et une limitation, privant l’humain de son geste, réduisant la possibilité d’accidents heureux, la sérendipité si courante dans la création artistique. Dans ce cadre l’innovation devient une lutte contre la machine normative.

Les plus acharnés défenseurs (lobbyistes) de l’usage généralisé de l’IA générative finiront par accepter que ce n’est pas un outil créatif mais bien une machine d’augmentation de la productivité (au détriment plus ou moins visible de la qualité), et continueront de vouloir l’imposer comme outil d’automatisation de tâches ingrates, de génération de déclinaisons dans différents formats d’un même contenu par exemple. Soit. Et dans ce cas précis, ne faudrait-il pas reposer la question centrale : le gain apporté par l’IA justifie-t-il alors, contrebalance-t-il tous ses coûts sociaux, environnementaux, philosophiques ? Notons encore que cette soi-disant automatisation n’est rendue possibl e que par l’exploitation colonialiste de millions de travailleurs en situation d’extrême pauvreté. La réponse à la question qui précède est très clairement négative, à moins d’accepter et d’assumer que son propre travail repose sur cette exploitation et en prendre la responsabilité. Gardons à l’esprit aussi que ces IA au coût démesuré ne trouveront pas leur rentabilité dans les outils spécialisés des professionnels. Cet usage profressionnel n’est qu’une vitrine marketting pour pousser la popuplation entière à un usage bien plus vaste et généralisé, et de ça aussi, les professionnels qui s’en saisissent doivent en avoir conscience. Personnellement, je m’y oppose fermement.

Aucun outil de création artistique n’a jamais posé de tels enjeux ; aucun outil artistique jusqu’ici n’avait jamais décidé en lieu et place de l’auteur et de l’autrice du contenu même de son œuvre, que ce soit sur des détails d’arrière-plan ou sur le sujet même. Avec l’IA générative les auteurs et autrices sont a minima partiellement dépossédés de leur propre discours, au profit d’une vision normalisée et normative du monde, jusqu’à parfois n’être que des pantins au service d’une idéologie qu’ils ne maîtrisent plus.

- Mussolini a dit : « Qui dit fascisme dit avant tout beauté ». Le fascisme joue avec l’esthétique en souhaitant prescrire la beauté, une beauté normalisée et kitsch par définition, qui a aussi pour vocation d’assigner des indentités, d’essentialiser des catégories de population entières. Et c’est exactement ce que montrent les quelques images générées par I.A. de cet article.

Michel Lacroix l’explique bien dans la conclusion de De la beauté comme violence, l’esthétique du fascisme français, 1919 – 1939, que vous pouvez lire ici dans son intégralité. Extrait :

« À de multiples reprises, en effet, nous avons pu montrer que le recours à l’esthétique ne sert pas à camoufler la violence sous une façade de beauté, mais, ce qui est radicalement différent, à justifier la violence exercée à l’encontre de la laideur au nom de la beauté. De même, l’exigence de beauté concorde parfaitement avec les visées totalitaires du fascisme, car elle conduit à imposer des normes prescriptives aux individus, faisant d’eux des acteurs malgré eux dans la mise en scène continuelle et omniprésente de ce fascisme. » ↩︎ - Dans 1984, publié en 1949, Georges Orwell décrit un système totalitaire où le gouvernement impose la novlangue officielle, soumise à une politique de réduction du vocabulaire : le nombre de mots en novlangue diminue sans arrêt, dans le but d’hébéter le peuple pour mieux le contrôler. ↩︎

- Ludwig Josef Johann Wittgenstein (1889 – 1951) est un mathématicien et philosophe autrichien puis britannique ayant notamment, et entres autres domaines, exploré la philosophie du langage. Ses rercherches philosophiques marquent aussi une étape importante du développement de la sociologie et font partie des références de Pierre Bourdieu. ↩︎

- S’il peut y avoir des débats sur l’opportunité d’utiliser le mot « racisé » au sein des mouvements antiracistes, il n’empêche que c’est un adjectif dont l’un des usages décrit un état bien réel : une personne dite racisée est une personne à laquelle une prétendue race est assignée, et par extension une victime du racisme. En se privant de cet usage possible du mot, on se prive de la possibilité de penser simplement l’existence même de catégories de population victimes de racisme. ↩︎

- En philosophie, l’industrie culturelle est un concept forgé par Thodor Adorno et Max Horkheimer de l’école de Francfort qui remplace la notion de « culture de masse ». Ils affirment que la diffusion massive de la culture met en péril la véritable création artistique. L’industrie culturelle (à l’époque le cinéma, la radio, la presse, la télévision, ce qu’on pourrait résumer par l’expression « médias de masse ») tend non pas à l’émancipation ou à la libération de l’individu, mais au contraire à une uniformisation de ses modes de vie et à la domination d’une logique économique et d’un pouvoir autoritaire. Le phénomène ne concerne pas seulement les pays totalitaires, mais également les autres pays, à commencer par les sociétés libérales. ↩︎

- Je pense aux efforts réels bien qu’insuffisants des films produits par Disney par exemple (on peut notamment citer La princesse et la grenouille, sorti en 2009), mais aussi aux productions variées dans la publicité, les films d’entreprises, les campagnes d’affichage où la volonté de diversité était de plus en plus souvent explicite, de ce que j’ai moi-même pu constater dans mon environnement professionnel. ↩︎

- En commençant par constater simplement que la nature propose des dimorphismes sexuels bien plus intéressants et variés que les stéréotypes humains habituels. ↩︎

- Adam Tauman Kalai et al., Why Language Models Hallucinate, OpenAI, 2025.

Dans cet article, les chercheurs de OpenAI expliquent que les hallucinations sont un artefact mathématique inhérent au fonctionnement et à l’entrainement des IA. ↩︎ - Le fascisme s’oppose ouvertement à la démocratie et l’individualisme, au nom de la masse incarnée dans un chef providentiel. Le fascisme rejette la notion d’égalité au nom d’un ordre hiérarchique naturel : il définit un « homme nouveau », un idéal de pureté nationale et raciale qui nourrit en particulier l’antisémitisme, l’homophobie, l’exclusion des personnes atteintes d’un handicap et exalte les corps parfaits et la tradition, tout comme il affirme une hiérarchie entre les « peuples forts » et les « peuples faibles » qui doivent être soumis. De façon générale, le fascisme exalte la force et s’appuie sur les valeurs traditionnelles de la masculinité, reléguant les femmes dans un rôle maternel. Il célèbre dans cet esprit les vertus guerrières en développant une esthétique héroïque et grandiose. Tous ces classements et cette hiérarichie sont de fait normatifs. ↩︎

- L’habituation est un processus fondamental de l’apprentissage automatique dans le cerveau. Elle consiste en la diminution graduelle de l’intensité ou de la fréquence d’une réaction à la suite de la présentation répétée ou prolongée du stimulus qui la déclenche. ↩︎

- Comme l’explique notamment Tali Sharot, une neuroscientifique israelo-britanno-américaine. Elle explique le lien entre habituation et discriminations dans cet excellent épisode du podcast Inner Cosmos du neuroscientifique David Eagleman : Why do familiar things lose their shine (& what can we do about it)? ↩︎

- Le cerveau, aveugle au monde extérieur, conserve un modèle interne, une simulation de ce monde ontologique, qui lui permet de faire des prédictions sur le monde et fonctionner de manière plus efficace, plus optimale et économe en énergie (il est moins coûteux pour le cerveau de faire une prédiction et de rester attentif, a postériori, uniquement sur les écarts entre les stimulus qu’il reçoit et ses prédictions, que de rester à l’écoute de tous les stimulus en permanence). Ce modèle interne est mis à jour en direct afin de rester aussi fiable que possible dans ses prédictions, dans un processus qui inclue l’habituation, dont la normalisation qui est notre sujet renforce le modèle dans une direction unique. Lire ou écouter le neuroscientique David Eagleman sur le sujet. ↩︎

- Je parle ici du mythe tel que conceptualisé par Roland Barthes, qui propage la doxa, l’image, que la bourgeoisie se fait du monde et qu’elle impose au monde. La stratégie bourgeoise est de remplir le monde entier de sa culture et de sa morale, en faisant oublier son propre statut de classe historique. ↩︎

Laisser un commentaire