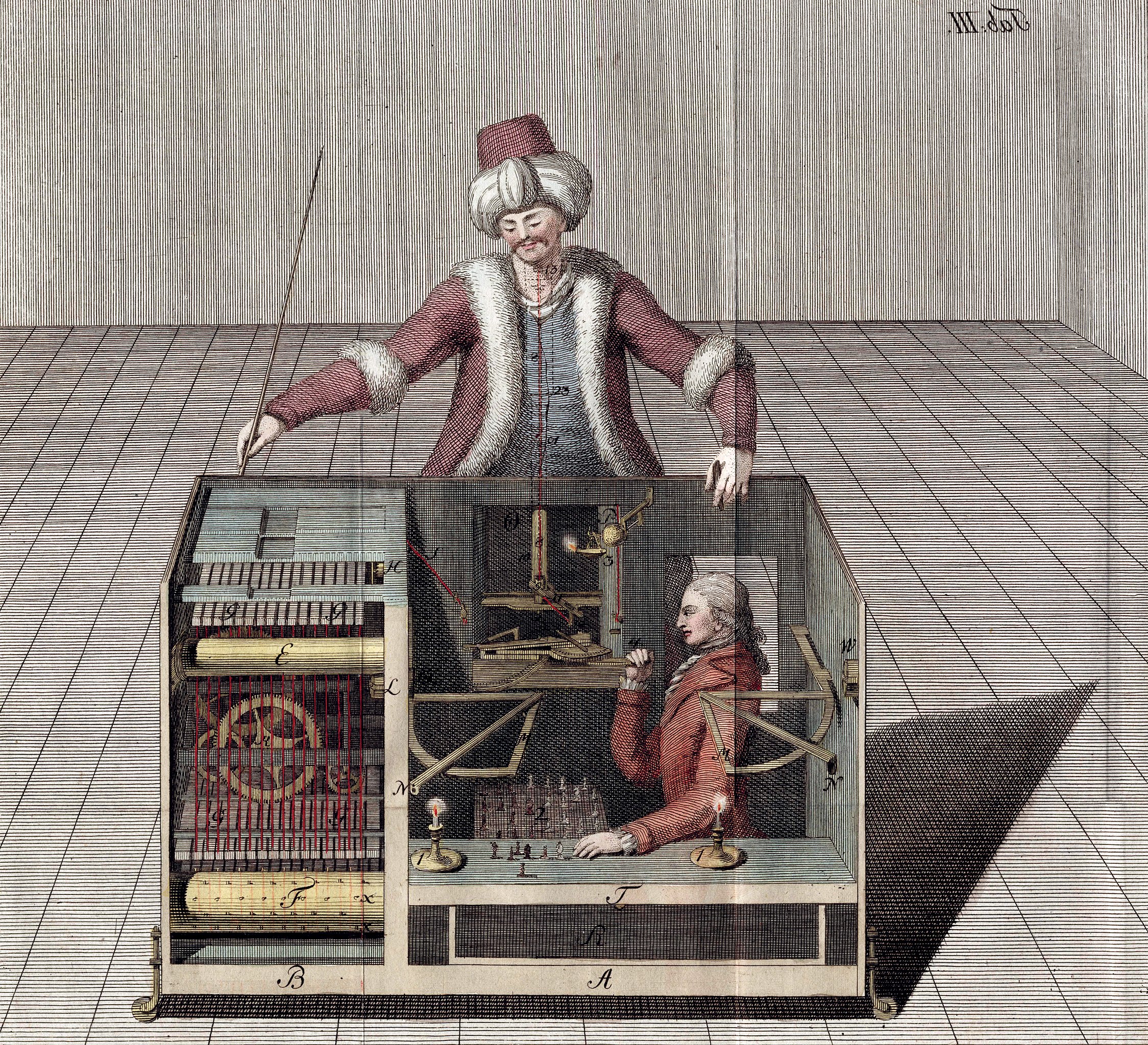

Le turque, Joseph Racknitz, 1789

On l’a vu en introduction1, et on le comprend intuitivement, l’intelligence est une propriété qu’on ne sait pas définir sans établir un rapport à l’humain ; en qualifiant l’apprentissage profond d’intelligence, même artificielle, on le lie ainsi sémantiquement à l’être humain, et on entretient le mythe selon lequel ces programmes informatiques sont capables de le remplacer. Il est tout à fait vrai que de tels programmes peuvent effectuer des tâches auparavant effectuées par des humains, finalement de manière comparable à un simple métier à tisser, sans besoin d’intelligence humaine. Mais il n’en est pas moins tout à fait faux de considérer que cet apprentissage profond, qui n’a rien d’intelligent, remplace effectivement du travail humain : tout au mieux, il le déplace, ou simplement le masque, de multiples manières.

Rien que par sa gourmandise en matériaux et énergies, cette manière de résoudre des problèmes ou effectuer des tâches automatiques nécessite bien plus de travail que ce qu’aurait fait une simple personne avec un périphérique « normal », qui ne soit pas un serveur surdimensionné. Il serait bien naïf de croire que cette expansion de l’exploitation minière, de la transformation des métaux, de la fabrication de puces informatiques et des bâtiments qui les abritent ainsi que de leurs systèmes de refroidissement, tout comme de la production énergétique, conséquence directe du développement des IA, ne nécessite pas un net accroissement de l’activité humaine et du travail.

Et une fois ce matériel en fonctionnement, on l’a vu, l’intervention humaine est toujours indispensable ; sans même parler des concepteurs et programmeurs du système, il y a toutes les petites mains, les ouvrières et ouvriers du clic chargés d’aligner les IA. Et enfin, il y a les humains nécessaires à la surveillance et la correction des erreurs de ces intelligences artificielles et stupides.

En 1930, John Maynard Keynes2 imaginait que la mécanisation autoriserait « une semaine de quinze heures » tout en consacrant « nos énergies encore disponibles à des buts non économiques » un siècle plus tard, c’est-à-dire en 2030. Dans les années 2020, le travail hebdomadaire moyen se situe toujours autour des 30 à 35 heures entre 25 et 55 ans3. Où est donc l’impact de l’automatisation ? Alors qu’on nous la présente comme une nécessité économique et concurrentielle, ce chômage technologique évoqué par Keynes est largement surestimé, et cache plutôt des orientations économiques importantes en nous privant de questions politiques importantes, telles que la détermination des salaires, la localisation et les conditions du travail, pour quelle production, pour qui, par qui4.

Les concepteurs des IA essaient à tout prix de nous cacher une somme énorme de travail humain, afin de présenter leur « outil » comme une espèce de baguette magique qui nous soulagera de tâches ingrates5, masquant le fait qu’ils n’ont fait que déplacer le travail ailleurs (notamment afin de le payer moins cher). C’est mathématique, et ils ne peuvent pas l’ignorer ; mais il est plus facile pour le monde occidental, du bon côté de l’IA, de fermer les yeux et de ne pas s’en préoccuper.

La voiture autonome est un exemple éloquent ; alors qu’Elon Musk6 promet tous les ans depuis 2015 que la voiture autonome existera dans l’année, des voitures « sans pilote » ont commencé à circuler dans plusieurs villes du monde entier, y compris avec des passagers commerciaux. Les services de police s’inquiètent de l’attribution des responsabilités en cas d’accident et en l’absence de conducteur, alors que les accidents ne sont pas rares, et peuvent être catastrophiques. Le 13 juin 2024, à Fullerton aux États-Unis, une Tesla roulant à vive allure en mode autonome a percuté de plein fouet, en pleine nuit, une voiture de police régulant la circulation, tous gyrophares allumés (la vidéo de l’accident a été postée le jour même par la police de Fullerton sur Instagram). Le conducteur était bien présent, mais sur son téléphone… Par chance, les policiers ont pu se précipiter sur le trottoir avant l’impact et il n’y a pas eu de blessés. Mais ce qu’on oublie, et surtout ce qu’on essaie de cacher, c’est que tous les véhicules soi-disant autonomes sont en réalité surveillés et contrôlés par un opérateur, à distance. Aucune voiture autonome n’est autonome, et les pouvoirs publics qui s’inquiètent de l’attribution des responsabilités en cas d’accident le savent bien.

Le véritable problème est bien l’humain derrière l’IA, et c’est un problème prégnant pour tous les automates, en particulier ceux qui concernent la sécurité des personnes et des biens. On sait parfaitement que le contrôle humain des automatismes ne fonctionne pas. Invariablement, les personnes en charge de la surveillance d’un robot finissent par avoir une confiance démesurée en l’automatisme7, sans compter le fait qu’on va progressivement leur demander de surveiller toujours plus d’instances à la fois, généralement par souci d’économie à court-terme. Si on confie à un humain la surveillance d’un automate, un accident, une « faute d’inattention » va inévitablement avoir lieu, comme dans l’exemple du chauffard au téléphone confiant sa voiture à l’IA. C’est vrai pour les voitures, c’est vrai pour la vidéosurveillance, c’est vrai pour la modération des contenus en ligne, c’est vrai pour les diagnostics en médecine… Plus une tâche est automatisée, et monotone, moins on y prête attention. C’est loin d’être une découverte récente ; c’est par exemple pour cette raison qu’on ajoute des dispositifs dans les cabines de pilotage des trains, et même dans l’habitacle des voitures, pour s’assurer de l’attention du chauffeur.

D’un côté, on a tendance à cacher les présences humaines derrières les machines, automates, robots ; de l’autre, on essaie d’assurer leur fiabilité grâce à « l’humain dans la boucle ». En fin de compte, l’humain dans la boucle sera le bouc émissaire des défaillances de l’IA ; on lui imputera la responsabilité des accidents dus à son inattention, à ses biais cognitifs bien connus et présents en chacun, sans jamais remettre en cause la présence même de l’automatisme.

L’accent mis sur la surveillance humaine comme mécanisme de protection permet aux gouvernements et aux fournisseurs de jouer sur les deux tableaux : ils peuvent promouvoir un algorithme en proclamant que ses capacités dépassent celles des humains, tout en défendant simultanément l’algorithme et ceux qui en sont responsables de tout examen minutieux, en soulignant la (supposée) sécurité fournie par la surveillance humaine8.

Ben Green, Université du Michigan

Finalement, les mensonges avérés des entreprises vendant de « l’I.A. », consistant en réalité en des opérateurs humains déguisés, ne sont peut-être relativement pas si graves en comparaison… Ainsi des « agents conversationnels » se sont révélés être de véritables gens répondant depuis un pays à la main d’œuvre moins chère que l’I.A.9 Ou, encore plus littéralement, Elon Musk, encore lui, a par exemple osé faire présenter un robot bipède autonome qui s’est avéré être un simple déguisement… Finalement, quoi de mieux pour faire de l’intelligence que d’utiliser des humains ? De là à les qualifier d’artificiels parce qu’on les cache dans des pays pauvres, il n’y a qu’un pas.

Derrière ces exemples emblématiques, les mensonges des entreprises technologiques en général, et de l’IA en particulier, sont nombreux ; le concept même de l’IA réside surtout dans l’opacité, des processus, des algorithmes, et aussi de l’organisation de la main humaine à l’œuvre.

- Lire Petite histoire de l’I.A. ↩︎

- John Maynard Keynes, 1883-1946 : économiste et essayiste britannique ↩︎

- Lire à ce sujet cet article de Martin Anota : Où est la semaine de travail de 15 heures promise par Keynes ? ↩︎

- Lire aussi Derrière les mots « intelligence artificielle » ↩︎

- Parce que oui, dans l’esprit capitaliste et transhumaniste de ces entreprises, même faire de l’art est un travail, une tâche ingrate, dont il faut se libérer. Surtout quand un employeur ou commanditaire doit payer pour. ↩︎

- Patron du fabricant de voitures Tesla. ↩︎

- Cet article de Ben Green de l’université du Michigan explique les failles de la surveillance des algorithmes par l’humain. Lire aussi à ce sujet l’article de Cory Doctow sur pluralistic.net : AI’s « human in the loop » isn’t ↩︎

- « The emphasis on human oversight as a protective mechanism allows governments and vendors to have it both ways: they can promote an algorithm by proclaiming how its capabilities exceed those of humans, while simultaneously defending the algorithm and those responsible for it from scrutiny by pointing to the security (supposedly) provided by human oversight. » ↩︎

- Les sociologues Maxime Cornet et Clément Le Ludec ont découvert une startup française faisant croire à ses clients que leur chatbot était de l’I.A. alors que les réponses venaient de véritables humains à Madagascar. ↩︎

Laisser un commentaire